"Warnung vor sensiblen Inhalten"

Neu in iOS 17: Nacktfoto-Erkennung für alle

Zu den neuen Funktionen von iOS 17 gehört ein Ausbau von Teilen der erst kürzlich eingeführten Jugendschutzfunktionen. Konkret steht die systemweite Nacktfoto-Erkennung, die verhindern soll, dass intime Fotos ohne vorherige Sicherheitsabfrage eingeblendet werden, nun allen Anwendung zur Verfügung.

Standardmäßig inaktiv: „Warnung vor sensiblen Inhalten“

Bislang wurde die Option den Nutzern der so genannten Familienfreigabe vorbehalten, die nicht nur eine entsprechende Familie in ihren iCloud-Accounteinstellungen konfiguriert haben mussten, zudem blieb die Schutzfunktion auch minderjährigen Anwendern vorbehalten.

In iOS 17 eine Systemoption für alle

Dies ändert sich in iOS 17 nun gravierend. So können alle Anwender fortan von der neuen Schutzfunktion Gebrauch machen und sich über Bilder informieren lassen, um die eventuell lieber ein Bogen gemacht werden sollte.

Was auf den ersten Blick wie eine Funktion aussieht, die die typische Prüderie amerikanischer Tech-Konzerne unterstreicht, ist eine sinnvolle und überfällige Systemerweiterung, die Anwendern keine Vorschriften macht, welche Inhalte auf dem eigenen iPhone-Bildschirm auftauchen, sondern lediglich dafür sorgt, dass diese ausschließlich dann eingeblendet werden, wenn dies auch gewünscht wird.

„Warnung vor sensiblen Inhalten“: Für AirDrop, Messages und Videonachrichten

Mehr Kontrolle für Empfänger

Die missbräuchliche Zustellung von „Dick-Pics“ und anderen unangenehmen Fotos durch unbekannte Kontakte und ungewünschte AirDrop-Übertragungen kann so vollständig ignoriert werden, während sich der Partner oder die Partnerin gerne auch weiterhin mit attraktiven Selfies für das Sektfrühstück am Wochenende bedanken dürfen.

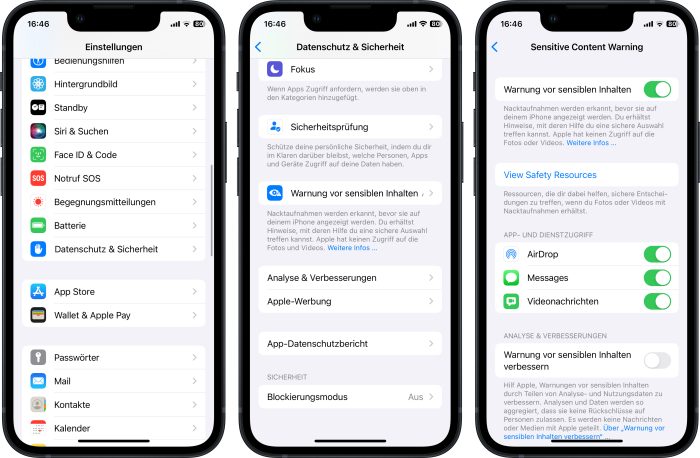

Die neue System-Einstellung lässt sich unter iOS 17 im Bereich „Einstellungen“ > „Datenschutz & Sicherheit“ > „Warnung vor sensiblen Inhalten“ aktivieren. Zudem können Nutzer hier entscheiden, ob Bild-Übertragungen per AirDrop, Nachrichten und Videonachrichten gleichermaßen geprüft werden sollen.

Solange optional – ist es ne super Integration.

Ja, und so lange die Erkennungsroutinen ausschließlich auf dem Gerät laufen, wovon ich aber ausgehe.

Selbst wenn’s nicht optional wäre, solange keine eigenen Bilder irgendwo zur (automatischen) Analyse hingeschickt werden sondern lediglich lokal mittels AI oder anderem Abgleich gescannt werden, sollte alles tutti sein.

Schau’n wir mal…

Levels of Automation (Sheridan, 2000):

– Computer bieten keine Unterstützung

– Computer schlagen alternative Wege vor, eine Aufgabe zu lösen

– Computer schlagen eine Entscheidungsalternative vor und

… führen diese aus, wenn Mensch diese billigt

… erlauben Menschen für eine begrenzte Zeit vor der automatischen Ausführung, ein Veto einzulegen

… führen automatisch aus und informieren den Menschen zwingend

… führen automatisch aus und informieren den Menschen nur auf Anforderung

– Computer wählt aus, handelt und ignoriert den Menschen

Ich denke das ist wirklich die beste Option.

Auch wenn mich die andere Option in keinster weise gestört hat.

Und gerade für meine Kinder doch eine gute Maßnahme ist.

Klasse Funktion und wenn das alles auf dem Handy erkannt wird top.

Finde es sehr interessant was die bildersuche so alles kennt, Baum, Hund, Meer, Pferd….. bekannte Gesichter, da ist die neue Funktion wohl ein Teil der Bildanalyse

Liest sich falsch übersetzt. Sende ich was sensibles dann habe ich vorher genau drauf geachtet, dass so wenig wie möglich zu sehen ist.

lol Finde ich tatsächlich auch. Delikat, anstößig oder explizit wäre wohl besser gewählt. Ich glaube die Amis benutzen das Wort Sensibel einfach anderes. Da muss der Übersetzer aber noch mal ran.

Nein, die benutzen es richtig. Sensible ist korrekt. Nur halt schlecht übersetzt. So wie Amazons App Updates mit ihrem „Geniessen Sie unser letztes Update“, wo latest mit „letztes“ übersetzt wird..

Die sollten was gegen den Spam tun

Was für ein Spam ?

Email Spam, SMS Spam, iMessage Spam, Fake Anrufe, unerlaubte Werbeanrufe (Du wollen Bitcoin kaufen?)

Du solltest deine Handynummer einfach nicht jedem geben ;)

Kann ich mir in der Fotos App ein intelligentes Album mit Bedingung Nacktbild machen?

Hehe ;)

Und bitte automatische Ausblendung aus dem normalen Fotostream… sonst muss man immer drauf achten wenn man irgendwem ein Bild zeigen will und mal durchscrollt ;)

Alben innerhalb der ausgeblendeten Fotos auch längst überfällig…

Durchaus würde ich das auch gut finden. Das solche Bilder nur mit Face ID und expliziten Fingertipp angezeigt werden. Und falls das jemand nicht ernst nimmt: es ist völlig normal Nackideibilder in seinen Fotos zu haben. Wir waren soviel reisen und dann gibt es halt mal nen Moment wo man halb nackt baden war, irgendwelche Quatschfotos geschossen hat etc. Das gehört alles dazu und dafür muss man sich nicht schämen.

DAS wäre mal eine sinnvolle Funktion!

Mich nervt das manuelle Pr0n Aussortieren schon seit Jahrzehnten! xD

Sehr guter Schritt in die richtige Richtung!

Leider wird eines der Probleme damit nur vertuscht: dumme Hirnlose schwanzgesteuerte Herren, die meinen ihr viel zu kleiner Penis muss als Bild verbreitet werden…

Mr. M, Haben Sie sich gerade selbst beschrieben? ;-)

was ist denn dann mit Bildern von Elefanten?

*fragefüreinenFreund :)

Viel wichtiger finde ich, dass ausgeblendete Fotos in Drittanbieter-Apps gar nicht offen angezeigt werden dürften und schon gar nicht, wenn diese App keine Zugriffsberechtigung auf alle Fotos bekommen hat!!! War mir in der Vergangenheit mehrfach aufgefallen! Das geht gar nicht!

Ich weiß jedoch nicht mehr, welche Apps das waren, ist zuletzt vor einigen Monaten gewesen und ich bin bei sowas ziemlich schnell im löschen der App, da damit das Vertrauen gebrochen wird!

Wer hat denn hier auch diese Erfahrung gemacht?

Ich hab bisher noch nicht gemerkt, dass Drittanbieter auf Fotos zugreifen können obwohl sie keine Berechtigung haben.

Meistens – sofern verfügbar – stelle ich sowieso ein, dass die App nur auf bestimmte Fotos zugreifen darf, die ich dann explizit auswähle.

Ich stelle mir gerade vor, wie beim Release von iOS 17 erstmal alle das iPhone nehmen und die Funktion ausprobieren :-) :-)

Ich bekomme keine Nacktfotos :-(