Warnung bei verdächtigen Suchen

Kindesmissbrauch: Siri und die iPhone-Suche sollen in iOS 15 intervenieren

Der erweiterte Schutz für Kinder, den Apple mit iOS 15 im Herbst ausrollen wird, steht auf insgesamt drei Säulen.

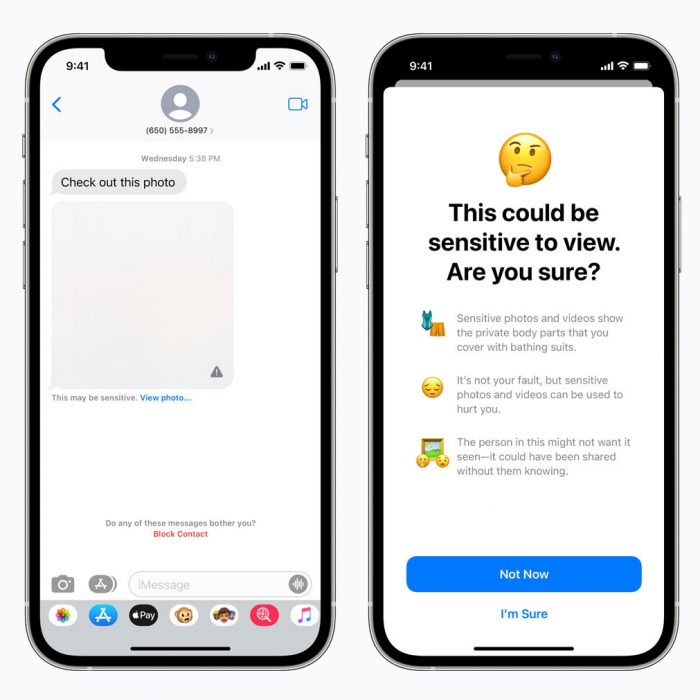

iMessage prüft auf Nacktbilder

Der Kurznachrichtendienst iMessage wird auf Geräten von minderjährigen Anwendern und Anwenderinnen aktiv nach Nacktbildern Ausschau halten und Kinder warnen, wenn entsprechende Bilder im Nachrichtenverlauf erkannt werden.

Erkennt iOS 15 ein ankommendes Nacktbild, zeigt das iPhone dieses nur nach zusätzlicher Nachfrage an und meldet den Aufruf, je nach Alter des Kindes, an die verantwortlichen Erwachsenen der Familienfreigabe.

Der iMessage-Schutz hat dabei erst mal nichts mit dem ebenfalls angekündigten Kampf gegen Bilder zu tun, auf dem die sexuelle Ausbeutung von Kindern abgebildet ist. Ist die Nacktbild-Erkennung in iMessage aktiv, wird der Messenger bei allen Nacktbildern anschlagen, auch wenn diese etwa von Heranwachsenden im gegenseitigen Einverständnis verschickt wurden.

Das iPhone prüft auf (bekannte) Missbrauchsbilder

Gegen den Kindesmissbrauch zielt die zweite Neuerung Apples. Mit iOS 15 sollen (vorerst ausschließlich in den Vereinigten Staaten) alle Bilder, die zum Upload in Apples iCloud vorgesehen sind, vor dem Transfer mit einer Datenbank bekannter Missbrauchsbilder abgeglichen werden. Ein Vorgang, der direkt auf dem Endgerät stattfindet. Die Initiative haben wir in den vergangenen Tagen ausführlich besprochen:

- Kinderporno-Scan: Apples Antworten lassen viele Fragen offen

Siri und die iPhone-Suche intervenieren

Die dritte Säule der Kinderschutz-Initiative betrifft Siri und die Suchfunktion des iPhones. Zwei Gerätekomponenten, die laut Apple fortan einen genaueren Blick auf die Sucheingaben der Nutzer werfen und intervenieren sollen, wenn Anwender nach Begriffen suchen, die möglicherweise im Zusammenhang mit dem Missbrauch von Kindern stehen könnten. Apple erklärt:

Siri und Search werden ebenfalls aktualisiert, um einzugreifen, wenn Nutzer Suchanfragen zum Thema CSAM stellen. Diese Interventionen werden den Nutzern erklären, dass das Interesse an diesem Thema schädlich und problematisch ist, und Ressourcen von Partnern zur Verfügung stellen, um Hilfe bei diesem Problem zu erhalten.

An dieser Stelle wollen wir an die bereits länger vorhandenen Inhaltsbeschränkungen von Safari erinnern. Der Wortfilter den Apple hier nutzt, enthält auch ganz unschuldige Wörter wie „Teen“ und „Asian“, die bei aktiver Kinderschutzfunktion gefiltert werden.

Sind die Inhaltsbeschränkungen aktiv, lässt sich nicht mal mehr nach „asian recipes“ oder „teen mental health resources“ suchen. Bleibt zu hoffen, dass die Interventionen von Siri und der iPhone-Suche etwas durchdachter ausfallen.

Was geht hier eigentlich ab? Und keiner berichtet groß drüber weil alle nur an c denken!

Man kann auch an beides denken. Probiers mal, es ist möglich.

Ich glaube selbst an eine Sache zu denken fällt ihm schon schwer. Nicht direkt überfordern.

Überfordere unseren Querdenker nicht!

Bin ja bei dir nur der Hinweis auf covid hätte man weg lassen sollen..

Ich schließe mich Dieter Nuhr an.

„Ich bin nicht von Mutti ausgezogen um mich dann von jemanden Bemuttern zu lassen“

– Zitat zumindest sinngemäß

Und mir soll auch keiner kommen, es soll ja nur.. ja das erzählen sie am Anfang immer.. und das hat ja bis lang ja auch super geklappt (und das in allen Richtungen)

Ob LKW Maut.. wird nur für ganz schwere Straftaten (Terrorismus) hat nicht mal 1 Jahr gehalten

Oder auch mal anders rum: nicht einmal 30% der in Deutschland unberechtigt abgehörten Telefonate, werden hinterher darüber informiert (obwohl es im Gesetz steht)

Heute ist es „Kindesmissbrauch“, morgen ist es Religion, Staatskritik, LGBTQ und und und. :-)

Setz Apple nicht so unter Druck. So schnell können sie die weiteren Themen bestimmt nicht umsetzen….

MIr fällt es schwer dir zu folgen. Kindesmissbrauch ist ein schweres Vergehen, und jedes Mittel es zu unterbinden ist doch löblich. Ob Apples Ansatz gut oder schlecht ist, wird sich halte zeigen. Wenigstens versuchen sie es. Ich lese nichts von den anderen Tech Giganten… das macht halt kein Geld.

Aber wieso setzt du es gleich mit Religion, LGBTQ? Religion und LBGTQ sind doch an sich nichts negatives. Kindesmissbrauch (zumindest für mich) schon.

Naja, lass uns mal abwarten was genau da passiert. Alles was ich bis jetzt gelesen habe ist standard gebashe das wenig differenziert ist.

Dann versetze dich mal in Machthaber anderer Staaten. Die sehen das leider ganz anders als du und könnten diesbezüglich weiteren Druck auf Apple ausüben.

>>Kindesmissbrauch ist ein schweres Vergehen<<

Richtig.

>>und jedes Mittel es zu unterbinden ist doch löblich.<<

Nein, geeignete Mittel sind löblich. Wir bauen auch nicht in jedem Schlafzimmer Überwachungskameras ein nur um dort (Sexuelle) Gewalt zu verhindern.

Die Kosten für den Verlust der Privatsphäre müssen mit dem Nutzen im Verhältnis stehen.

Die Hashwerte kann man mit einer in 10 min. programmierten App austricksen dafür können sie leicht verwendet werden und einfach „ausversehen“ Bilder für Homosexualität, Memes von Assad oder Christliche Symbole im Iran genutzt werden.

„oups“ schon kann jeder Autokrat jedem arglosen iphone-nutzer seine Staatstreue zuordnen.

Leider kann man unter der Fahne von Kindesmissbrauch praktisch alles durchsetzen. Man sieht es an deiner Reaktion. Andere Überwachung wird garantiert folgen. Wieder ein Stück Freiheit abgegeben und einige jubeln Beifall. Übrigens habe ich Kinder, Kindesmissbrauch ist das schlimmste was ich mir überhaupt vorstellen kann, aber, Überwachung der Nutzer das geht mir viel zu weit. Ich habe mich für Apple entschieden weil die keine Daten gesammelt haben und jetzt kommt sowas.

Homosexualität war auch in Deutschland lange ein Vergehen. Noch heute werden Homosexuelle mit Kinderschändern in einen Topf geworfen („Verführertheorie“). In anderen Ländern herrscht keine Religions- oder Meinungsfreiheit. Denk doch mal bitte eine Sekunde über deinen Horizont hinaus, bevor du alles unkritisch abnickst.

Also andere cloud Anbieter machen die ja schon lange (auch apple) neu wandern diese einfach nicht mehr auf apple’s server mit den hashes verglichen, sondern direkt auf dem phone. Aber nur wenn du iCloud für die Fotos nutzt.

So ist es leider!

Und wer es nicht glaubt, beschäftige sich mal damit, was Apple in China macht, um dort verkauft werden zu können oder wie sehr Hollywood extra für den chinesischen Markt Filme dreht und auf entsprechende Anfragen seitens China reagiert!

Wer glaubt, das es dabei bleibt, sollte sich mal die Mühe machen und in Berlin das Stasi-Museum besuchen.

Im Endeffekt geht es nur um Märkte und Geld. Die Menschen und Co interessieren die Hochfinanz überhaupt nicht.

Und da ja nur hashwerte überprüft werden ist es ein Leichtes Apple die „richtigen“ Werte für Staatskritik, LGBTQ oder die falsche Religion unterzujubeln.

Danke Apple für Orwellsche verhältnisse auf dem iPhone.

Dann brauche ich auch nicht mehr das vierfache für ein iPhone ausgeben.

Überwachen lassen kann ich mich auch bei Xiaomi & Co.

Du verharmlost Kindesmissbrauch wenn du die anderen Dinge auf einer Ebene setzt. Das ist krank!

Die Analogie zu ziehen ist überhaupt nicht krank, Frank!

Wer das eine auf einem iPhone suchen kann, kann auch das andere suchen! Nichts Krankes dran!

Du verharmlost Kipo wenn du die anderen Dinge auf einer Ebene setzt. Das ist krank!

Du verharmlost Kindesmissbrauch wenn du die anderen Dinge auf einer Ebene setzt. Das ist krank!

Guck doch mal über dein Tellerrand. Und wie es hier selber schon oft gesagt wurde. Apple öffnet ein Tor das man in anderen Staaten für uns ganz harmlose Sachen missbrauche kann. Hast du in China irgendwas aufm Handy was gegen den Staat ist kann man damit scanne und dich in den Knast stecken.

Zumindest Werbung für diese Sache mit den vielen Buchstaben machen sie ja schon kräftig. Fällt mir unangenehm auf. Armbänder, Ziffernblätter, Hintergründe, Spenden, iMacs und iPhones in vielen Farben. Relativ überrepräsentiert, was nicht verwundert bei Tim Cook. Nur: Gesinnung könnte man etwas unauffälliger zur Schau stellen.

Ich weiß auch, dass man nicht alles kaufen/nehmen muss, was im Angebot ist.

Es ist nur: Falls es mal zur iPhone-Gesinnungsprüfung käme, wäre meine Gesinnung (straight, weiß, alt und männlich) dann denn noch genehm?

In diesem Sinne: Apple! Finger weg von meinem iPhone!

Willkommen in iOS … äh… spyOS 15

:) Schöne Wortschöpfung.

Meldet es den Aufruf an mich als Elternteil oder zeigt es mir auch den Inhalt? Wenn mein minderjähriges Kind im Einvernehmen einem anderen minderjährigen Kind die geschlechtsteile zeigen möchte, hab ich sie dann auf dem Handy und werde von Apple gemeldet? Ich bin verwirrt

Du wirst wohl nicht das Foto zugeschickt bekommen, nur darüber informiert und aufgefordert nachzugucken ob es dem Kind gut geht.

Trotzdem bullshit, und wer sein echtes Alter in die Apple ID eingibt hat eh die Kontrolle über sein Leben verloren.

Letzteres , nein

Ich will die Funktion ausschalten können. Wann das mein Gerät (iPhone/iPad) ist will ich auch bestimmen können was darauf läuft und was für Prozesse meinen Akku Leersaugen. Es werden sicher spannende Klagen kommen…

Das mit iMessage und Nackbildern bei Kindern ist OPT-IN. Und nur wenn die iPhones im Familienzusammenschluss sind.

Ist auch gut auf dem ersten Bild des obersten Links zu sehen, dass das bei der Einrichtung/Update des Gerätes wählbar ist.

Das wird jedoch nichts daran ändern, dass die Funktionalität fester Bestandteil von iOS werden wird, also vorinstalliert und prinzipiell aktivierbar sein wird.

Langfristig dann über Pegasus frei konfigurierbar und ohne Zutun des Nutzers funktionsfähig gemacht ;-/

Sei froh, dass du das iPhone noch ausschalten kannst. Irgendwann fällt auch das weg…

Hurra, die Kommentare werden immer bekloppter.

Der ist gut. Wo kämen wir da hin, wenn der Überwachte einfach die Wanze abschalten könnte!

Danke für den Überblick. Alle haben sich nur auf die Bilder konzentriert.

Ich finde alles drei zusammen unerträglich.

Sehr richtig.

Ich meine, alles was da steht macht jedes derzeitige Telefon. Nur halt nicht für Kindesmissbrauch.

Bilder werden alle gescannt um die Personen zu erkennen einzuordnen. Ab iOS15 zeigen sie dir automatisch was in dem Bild steht und geben dir mehr Infos. Was neu ist: Der Algorithmus hat mehr Parameter bekommen um nackte Kinderbilder und Missbrauchsbilder zu erkennen.

Das Gleiche gilt für die Suche. Alles was du eingibst geht zu Google und wird auch von denen für dein Profil genutzt. Dir ist sicherlich schon mal aufgefallen, dass du heute was eingibst und Instagram dir rein zufällig Werbung zu exakt dem Thema zuspielt. Also auch ist ist das nichts neues… außer dass jetzt geprüft wird ob du irgendwelche Kindermissbrauchsseiten suchst.

Alles was gerade passiert ist seit längerem Realität (besonders für Android / Chrome User). Apple versucht den ganzen Müll halt auch für etwas non-profit zu nutzen. Und da springt jeder auf. Tja, Kinder sind halt keine gute Lobby. Wartet mal ab bis ihr Eltern seid und auch nur einen Gedanken in sowas investiert….

Das eine ist das Scannen der Bilder nach Merkmalen- ok, das gibt es schon länger. Die Konsequenzen allerdings, wenn die Erkennung explizit in Richtung Kindesmissbrauch anschlägt sind neu. Und genau das schmeckt mir nicht- alle über einen Kamm scheren und verdächtigen, false positives riskieren und Regierungen ein weiteres Werkzeug an die Hand geben, die Freiheit der Nutzer einzuschränken.

Wurde ja bereits x- fach geschrieben- wer kann garantieren, dass es bei CSAM Erkennung bleibt?

Alles was du beschreibst passiert freiwillig und kann deaktiviert und geändert werden. Was jetzt hier passiert entzieht dem Benutzer aber die Kontrolle und zusätzlich auch die Möglichkeit zur Überprüfung, was, wann, wo, von wem auf dem eigenen Gerät gescannt wird.

Mal drüber nachgedacht was das (für die Zukunft) bedeutet?

Das meiste kannst du halt nicht deaktivieren, was mehrfach belegt wurde. Aber ich verstehe was du meinst. Was die Zukunft bringt und ob eine Funktion wie (aus)genutzt wird, bleibt abzuwarten.

Natürlich kann es deaktiviert werden, einfach iCloud Fotos nicht nutzen. Und zum 100sten Mal, alle Fotos die in die Cloud gehen werden gescannt, bei anderen Anbietern ebenso, Apple macht das nur vorab auf dem Gerät…wenn man iCloud Fotos nicht nutzt wird nichts gescannt. Hier werden Kommentare abgesondert, also bitte. Und wenn mein Kind über iMessage anstößige Bilder bekommt werde ich informiert, ist doch super, viele hier haben scheinbar keine Kinder und keine Ahnung. Und diese Argumente „das kann man alles missbrauchen“, natürlich, kann man, aber es passiert ja aktuell nicht. Und denkt ihr Google, Samsung usw. machen es anders in China um dort auf dem Markt präsent zu sein?? Schon ne Menge sinnfreier Kommentare hier. Ihr wisst schon worum es geht, es soll die Verbreitung kinderporongraphischer Inhalte verhindert werden. Eigentlich ne super Sache. Dass Google jedes Foto das zu Google Fotos hochgeladen wird schon immer scannt, hat das jemals jemanden interessiert???

Die neue Kindersicherung find ich sogar ohne eigene Kinder super. Wenn man den Kids schon ein iPhone in die Hand drückt sollte man als Elternteil auch die AppleID verwalten und wert auf Medienkompetenzerziehung legen. Da unterstützt die Funktionalität doch ganz gut.

Relativ nutzlos ist aber die andere Funktion, denn seien wir mal ehrlich: zu einem sehr hohen Prozentsatz werden sich auf den Geräten z.B. der iFun User keine bekannten Kinderpornografischen Inhalte befinden = wenn der Algorithmus anschlägt ist es sehr wahrscheinlich eine Falschmeldung.

Und die wenigen Wesen, die sich diese Inhalte angucken und untereinander austauschen sind „gewarnt“ und nutzen einen anderen Weg.

=> Erfolg gleich 0 aber ggfs. Nachteile für die breite Masse.

Das erinnert mich ein wenig an die Millionen Euro für diese Stopschilder: die konnten in Sekunden ausgehebelt werden für explizite Seiten von den Pädophilen, somit Geldverschwendung und zeitgleich tausenden aber grundlos die Webseite zum Freibad unnütz geblockt weil auf einem Foto ein Kind in Bikini/Badehose abgebildet war…

Ahja. Ihr heisst ja iphone-ticker, aber wie sieht es denn mit dem macOS im Herbst auch. Kommt das bei Fotos, Siri und iMessage auch?

Siri kann noch nichtmal mehrere Timer stellen aber die Anfrage „zeige mir Bilder mit illegal entstandenen oder verbreitetetem Material das *** zeigt“ soll etwas zu Tage fördern?

Da kommt doch eh nur ein „das kann ich leider nicht beantworten“

Apple überschätzt den Technischen Entwicklungsstand von Siri gegenüber Konkurrenzprodukten mal wieder über alle Maße. Das

Frage mich auch wofür. Wenn ich sage „zeige mir Pornobilder“ kommt „ich habe dazu nichts im Internet gefunden“. Also….das Internet ist doch sauber ;-)

Zitat: „alle Bilder, die zum Upload in Apples iCloud vorgesehen sind“

Da stellt sich mir folgende Frage: Was wenn ich den iCloud Upload NICHT nutze?

Das stand in früheren Artikeln: Dann ist in der Tat der Scanner, der die Hashes ermittelt, NICHT aktiv. Das Nicht-Nutzen von iCloud-Fotos ist aber wohl auch der einzige Weg, den Scanner zu unterbinden.

Sollte aber wenn dem sicher so ist, deutlich stärker in den Vordergrund gestellt werden. Es gibt somit sehr wohl eine Möglichkeit auf iOS 15 zu wechseln & das scannen/vergleichen dennoch nicht zu akzeptieren. Dann wird der iCloud Upload ausgestellt & ein privates NAS genutzt.

Dafür direkt die Frage: hat jemand eine gute Empfehlung für ein NAS und eine App, die den Upload immer automatisch im Hintergrund durchführt?

Ja, die App Photosync.

Trotzdem ist dan das trojanische Pferd auf deinem iPhone ;)

Und nicht in den USA zu wohnen, ist ein guter Weg. Denn nur dort wird gescannt.

Ich denke wo du wohnst dürfte egal sein, vermutlich ist die Landeseinstellung im Account und/oder iPhone wohl ausschlaggebend.

Deine Texteingaben werden aber weiterhin gescannt. (Suche und SIri)

Das ist alles so absurd. Es geht darum Verbrecher ausfindig zu machen und die können das vermeiden indem sie iCloud deaktivieren.

Da darf ein Vergleich nicht fehlen: alle Leute lassen die Haustür offen und die Polizei darf reinkommen, außer bei den Verbrechern, die schließen ab.

Beschränkt sich das tatsächlich nur auf Bilder? Was, wenn Filme verschickt werden?

Nein das betrifft nun auch Text, also was du in die Suche eingibst wird gescannt und wenn das nach CSAM aussieht, dann triggert das eine Warnung/Belehrung über dein Verhalten mit Verweisen zu Informationen und Hilfen, falls nötig.

Das wird mit Sicherheit bald auch auf Videos ausgebaut.

Was ich mich frage: Apple analysiert eigentlich alles was die User auf den Geräten machen, ich denke das das triggern der Warnung/Belehrung auch ausgewertet wird. Natürlich um das System zu verbessern, aber eventuell auch um den Benutzer zu „beurteilen“. Das wird teilweise schon gemacht um das Risiko beim Einsatz von Bezahlsystemen abzuschätzen (ApplePay). Wenn nun solche „Bewertungsfaktoren“ hinzukommen sollten, dann wär das extrem gruselig.

Der Blick über die Schulter und die Schere im Kopf.

Willkommen im neuen Zeitalter.

Hallo, wenn das nicht zum deaktivieren ist dann muss ich mich von Apple leider verabschieden. Auf meinem Gerät hat niemand etwas zu scannen egal ob Apple oder sonst wer egal unter welchen Vorwand auch immer. Ich war immer sehr mit Apple zufrieden und möchte kein anderes OS verwenden da ist für mich aber der Punkt wo es zu weit geht. Was iCloud angeht ist mir das egal schon klar das die gegen Sachen vorgehen die auf ihre Server geladen werden. Die Devices von Apple habe ich gekauft und niemand hat mir vorzuschreiben was ich damit mache oder sie zu durchsuchen.

warum nicht gleich Kameras in den Wohnung installieren, verstehe den Umweg über Apple nicht. Es geht doch nur um eins, es geht um deine Daten

Genau genommen hast du das bereits unterschrieben. Denn in den AGB steht ja eben, das du nur der NUTZER und nicht der ADMINISTRATOR der gekauften Geräte bist. Du hast NICHT das Recht erworben die Geräte zu verwalten oder zu kontrollieren. Du darfst sie nur nutzen und im Rahmen der dir gegebenen Möglichkeiten konfigurieren.

Wenn die Geräte dir gehören würden, dann könntest du da jedes OS drauf installieren was dir gefällt, oder jeden Browser verwenden der dir gefällt, beides geht ja, bekannterweise, nicht.

PS: Alle Browser unter iOS verwenden zwingend Safari im Unterbau, welcher durch das OS gesteuert wird (API).

Deine erwähnten Einschränkungen betreffen nur Geräte von Apple.

Wenn mehrere Leute umschwenken auf LineageOS oder GraphenOS könnte man Apple oder die Regierung zum umdenken bewegen. Mit den beiden erwähnten OS kann man den Behörden das Schnüffeln sehr erschweren, nicht komplett unterbinden.

das wird jedoch wunschdenken bleiben. Jetzt schreien alle auf und im September wird fleißig iOS15 und iPadOS15 installiert. Das gleiche Spiel wie bei WhatsApp. Die Menschen wollen scheinbar überwacht und bespitzelt werden.

Aber auch nur scheinbar.

Ich nämlich sogar anscheinend nicht.

Und ich werde voraussichtlich auch nicht iOS/iPadOS 15 installieren, solange dieser Unsinn umgesetzt werden soll.

Wenn du die iCloud Fotomediathek nicht nutzt, wird auch nichts lokal gescannt. Werde sie dann auch abstellen.

Wieso? Wohnst Du in den USA?

Nein aber soweit ich das richtig verstanden habe, soll das erstens auch auf andere Länder ausgeweitet werden und zweitens soll die EU das sogar befürworten. Dürfte dann ja nicht lange dauern bis das in Deutschland auch gilt.

Also wird das doch auch direkt auf das scannen von Text ausgeweitet! Werden alle Texteingaben in iOS-Geräten so gescannt? Oder nur Suchanfragen?

Alter, das ist alles so gruselig, das Potential der Kontrolle und noch viel schlimmer der Steuerung ist so abartig groß.

Wie kommst Du darauf?

Pegasus vorinstalliert :)

Ich finde es sehr interessant wie viele Personen sich über diese Funktion aufregen, obwohl Apple es eigentlich nur gut meint.

Wahrscheinlich wissen die meisten noch nicht einmal wenn Sie irgendwelche Apps installieren oder Spiele, was diese alles scannen.

Hinzukommt WhatsApp Facebook Twitter TikTok usw. bei dem auch jeder allen scheiss postet und sich keiner Gedanken über die Rechte macht bzw. die Weiterverarbeitung der Daten.

Jetzt wird auf dem Telefon/während dem Upload gescannt ob es kinderpornografische Inhalte gibt! Finde ich genauso gut, wie die Bevorzugung von Geimpften in Zeiten von Corona! Und ich würde den ein oder anderen Taler wetten, dass bald weitere Hersteller/Programmiere von Telefonen oder Handybetriebssystemen nachziehen werden. Come one – come all!

Ich gebe dir prinzipiell Recht. Aber bitte bedenke das die Installation von Apps freiwillig sind. Das der Upload von Fotos in eine beliebige Cloud, die dann und dort(!) die Bilder scannt, freiwillig ist. Du selbst hast die Kontrolle über deine Entscheidung was du mit wem teilst. In diesem Fall entzieht dir Apple die Kontrolle und du bist so lange ein Straftäter bis du immer und immer wieder das Gegenteil durch das scannen deiner Texteingaben und Bilder bestätigst. Im Moment, lässt sich das noch teilweise(!) deaktivieren, aber die Geschichte beweist ja das sich das schnell ändert.

Erkennst du denn nicht welcher Weg hier beschritten wird? Ist es wirklich so schwer für dich den zweiten Schritt voraus zu sehen? Meinst du wirklich das es so bleibt, und das System nicht weiter und tiefer integriert wird?

Facebook, Instagram, Twitter, TikTok, Tinder, Lovoo, … werten mein Nutzungsverhalten aus!? WAS?!?! Das ist mir neu! :-D

Naja, das Geschrei ist doch immer laut wenn etwas ÖFFENTLICH angesprochen wird.

Ich glaube, so lange man etwas nicht weiß ist es einem auch egal.

Zusätzlich vermute ich, dass dadurch die Zielpersonen die das Apple-Device für die Verbreitung solcher Medien genutzt hat, in Zukunft nicht mehr nutzen wird.

Wir (Menschen) werden immer spezieller, aber ein Heilmittel gibt es auf Softwareebene m.M.n. nicht.

Der Weg zur Hölle ist halt mit guten Absichten gepflastert!

Es ist und bleibt ein Unterschied, ob bei Nutzung einer bestimmten App Analysen über den Inhalt gemacht werden, oder die Analyse (und daraus folgende Konsequenzen) direkt in das Betriebssystem integriert werden. Da bleibt dann im Extremfall nur noch der Plattform Wechsel.

Den unterschied musst du mir aber jetzt genauer erklären.

diese hinweise von siri und suche sind die deaktiervierbar?

Nein. Warum solltest du auch nach CP suchen wollen?

Danke Melvin für die Info, deinen letzten Teil kommentiere ich mit einem: Ich will einfach keine Vorabzensur. Egal wo egal welcher Bereich. Und nebenbei ist die reine Suche danach auch nicht strafbar.

Es ist keine Zensur, sondern ein Hinweis, dass Du da gerade etwas illegales machen willst.

Das ist die Schere im Kopf, die Dein freies Denken beeinflussen wird.

Niemand hat die Absicht eine Mauer zu erichten.

Wer nichts zu verbergen hat, braucht auch nichts befürchten.

Wenn das gut läuft, mit dem iPhone, dann könnte man doch schon mal den Grundstein für die Mac’s (und später die PC’s legen).

Vielleicht könnte man präventiv auch mein Surfverhalten beeinflussen…kein Porhub mehr, nur noch Katzenvideos (insofern da keine Urheberrechte verletzt werden.) Und wenn doch was gefunden wird, den Inhalt direkt an die Staatsanwaltschaft weiterleiten und den ganzen Rechners versiegeln bis die Kollegen da sind. Außerdem müsste die Gesellschaft natürlich vor mir gewarnt werden…

Wenn ich das richtig verstehe, dann wird die Suche nicht ausgeführt wenn CSAM in deinem Text erkannt wird.

Also ist das ja vom Prinzip schon so wie du schreibst:

Ich denke wir werden uns daran gewöhnen müssen, dass Apple/Google/usw. zu einer Vorinstanz, also einer Art Aufsicht für Behörden werden.

Ich bin mir nicht sicher was ich von dieser Zukunft halten soll.

PreCrime… und die PreCogs sitzen in Deinem iPhone.

Echt gruselig.

Was ist denn wenn ich ein Bild meines 1-jährigen in die Familiengruppe poste wie er nackig am Strand flitzt. Wie versteht der Algorithmus hier den Zusammenhang? Sicher gar nicht und dafür kann sich dann ein Apple Mitarbeiter durch meine privaten Bilder wühlen. Ich bin total dafür alles menschenmögliche gegen Kinderschänder zu tun! Gerade die Strafen sollten hier weitaus abschreckender und krasser sein! Aber das geht in die falsche Richtung.

Nein, nein und nochmals nein.

Wenn dein Foto von deinem Kind mit einem der Hashes übereinstimmt, dann hast Du ganz andere Probleme.

Es ist nicht ganz so:

Es werden nur „bereits bekannte“ Bilder direkt an Apple gemeldet, nur diese werden dann nochmal von einem Apple-Mitarbeiter gesichtet und dann wird das an Behörden übergeben falls nötig. Aaaaber…

Das Bild wird sehr wohl als Nacktbild eines Kindes erkannt, wenn du versuchst das zu teilen, bspw. per iMessage dann wird das bemängelt, wenn die Funktion dafür aktiviert ist. Derzeit ist aber davon auszugehen, dass alle Fotos gescannt werden und intern bewertet werden, damit die NE(NeuralEngine) dazulernen kann, es wird dir dann halt nur nicht angezeigt.

Außerdem werden deine Texteingaben gescannt! Im Moment wohl nur in der Suche, aber auch hier wäre ich mir nicht so sicher. Wenn du also etwas von einem nackigen einjährigen Kind schreibst, nun ich glaube das würde ich in Zukunft lieber lassen…

Geh einfach davon aus, dass deine Eingaben, egal ob es Bilder, Text oder Videos sind, in Zukunft auch von anderen beurteilt werden, auch wenn es zunächst nur eine KI bzw. NE ist.

Ihr gebt euren Kindern Smartphones? Dann lebt gefälligst mit den Konsequenzen! Apple und alle anderen müssen darauf reagieren.

Du meinst, wenn der Erziehungsberechtigte seiner Aufgabe nicht gerecht wird, muss ein Hardwarehersteller für Ordnung sorgen?

Vielleicht kann ein Hersteller beim erstellen und verbreiten von Kinderpornografischen Inhalten gleich den Zünder zur Selbstzerstörung samt Besitzer auslösen.

Also die ganze Diskussion fängt bei den Amis an. Ihnen muss man sagen dass der Kaffe heiß ist.

Die Katze nicht in die Mikrowelle gehört.

etc.

appl wurde verklagt weil die „beim fahren nicht stören“ Funktion nicht bei Auslieferung aktiv war.

das Land macht es einem echt schwer nicht alle für Hinterwäldler zu halten. Natürlich ist es nicht der Fall.

Siri ist eh ne dumme Nuss.

Bin gespannt, wann bestimmte Ausdrücke, Bilder und Wörter automatisch als „möglicherweise rassistisch“ ausgewiesen werden.

Dafür gibts ja dann die Bl*cklisten.

Uups – schon zensiert worden.

Was passiert eigentlich, wenn jemand ein kinderporgnografisches Foto in eine Chatgruppe eines Messengers postet, der so konfiguriert ist, dass er alle Fotos automatisch in der Foto-Library ablegt…? Kann man also zukünftig durch „KiPo-Bombing“ Leuten die Polente ins Haus schicken? Das würde bedeuten, daß man keinem Tool mehr das automatische Speichern in der iCloud erlauben kann, weil man sonst mit einem Bein im Knast steht.

Wenn man ein Bild geschickt bekommt, dann ist das nicht strafbar, egal was zu sehen ist. Meine Güte, man könnte hier meinen, wenn ein Foto eines nackten Kindes auf dem iPhone ist bedeutet das automatisch 15 Jahre Knast ohne vorherigen Prozess. Was Kommentare hier…ohne Worte

Wie geschrieben bin ich für eine Harte Strafverfolgung von Kinderschändern, aber, das geht entschieden zu weit. iOS 15 kommt erstmal nicht auf unsere iPhones. Unsere nächsten Geräte werden vermutlich von einer anderen Firma sein, wenn Apple nicht zurück rudert. Ich glaube bei Apple baggerts? Damals einen auf heilige Kuh machen, von wegen wir helfen sogar dem FBI nicht, jetzt kommt sogar eine Überwachung der Nutzer? Was kommt als Nächstes? Prüfung auf illegale Filme, Musik, verbotene Bücher?

Für die Leute, die Ihren Kindern einfach mal so ein Handy in die Hand drücken und dann völlig alleine lassen, ist das sicherlich eine einfache und bequeme Sache. Das sind dann aber auch die Eltern, die der Meinung sind, dass die Schule für die Erziehung und Aufklärung Ihrer Kinder verantwortlich ist und sich dann noch wundern, wenn später die jugendlichen „Diggers“ und „Alders“ mittags bekifft, schwanger oder arbeitslos nach Hause kommen, weil keiner Ihnen erklärt hat, dass Nacktfotos rallig machen, ein lebenlang im Internet bleiben, der Chef das gar nicht gut findet und es Bonsche und Luftballons gibt, die eine ungewollte Schwangerschaft verhindern…

Kinder gehören auch hier aufgeklärt. Und zwar durch die Eltern.

Apples Absichten in allen Ehren, jede Kinderseele muss geschützt werden, aber langsam fühlt es sich nicht mehr richtig an und bekommt irgendwie einen unangenehmen Beigeschmack.

Mittlerweile interessiert sich Apple doch sehr auffällig für unser aller privates Sexualleben.

(Bei Androids Google, weiß ich wenigstens, was die mit meinen Daten machen…..)

In diesem Sinne

Apple soll sich aus meinen iPhone raushalten!

Hier wird zu viel Verantwortung auf Apple und andere Hersteller und Softwarefirmen abgewälzt. Seit klar war, dass iCloud Backups nicht sicher vor dem Zugriff „Dritter“ sind, kann man es nicht mehr nutzen. Seit klar war, dass Fotos in der iCloud durch unberechtigten Zugang ungewollt veröffentlicht wurden ist es ebenso ein NoGo die Cloud für Fotos zu benutzen.

Wenn iOS 15 nun so wird wie beschrieben, dann werde ich wohl wieder auf den Jailbreak angewiesen sein, um das iPhone inklusive Schutz der Privatsphäre nutzen zu können. Eigentlich schade, denn mit den Entwicklungen in iOS 14 diesbezüglich war ich der Meinung, dass Apple auf dem richtigen Weg ist. Trotz der erwarteten und eingetroffenen Widerstände.

Ich denke es kann nicht Apples Aufgabe sein die Strafverfolgungsbehörden automatisiert zu ersetzen. Wohin das führt sieht man in allen Bereichen wo Hoheitsgewalt an private Firmen abgegeben wird. Missbrauch.

Die Diskussion zeigt doch ganz gut, wer noch Vertrauen zu Unternehmen und Regierungen hat und wer nicht und wer Privatsphäre über Verbrechensbekämpfung stellt.

Es gibt im Datenschutz einen Grundsatz und der ist simple: Wo Daten erhoben werden, werden Daten missbraucht. War schon immer so und wird so bleiben. Es gibt nur einen Ausweg: Verhindern, dass Daten erhoben werden.

Bin mal gespannt, wieviele Pädos sich bei Apple bewerben um „beim Kinderschutz mitzuhelfen und die Perversen zu überführen, die Kinderpornos auf ihren Handys haben“.

Apple soll die Verhältnismäßigkeit wahren und diese Funktionen deaktivieren. Die Nebenwirkungen sind imo größer als der Nutzen. Stattet lieber Strafverfolgungsbehörden besser aus. Dann braucht es solche System, die Millionen Menschen unter Generalverdacht stellen, nicht.

Super,

Letztens eine Fahrradflasche namens ‚Elite Loli‘ gesucht. Google hat mich zuallererst einmal drauf hingewiesen, dass Kindesmissbrauch strafbar ist. Schön, wenn man so leicht ‚ins Visier‘ gerät.

Überwachung auf meinen eigenen Geräten verbitte ich mir. Andere Hersteller haben ja auch schöne Hardware.