Erweiterte Foto-Infos anzeigen

iOS 15.4 bringt Apples „Visual Look Up“ nach Deutschland

iOS 15.4 wird die hierzulande „Visuelles Nachschlagen“ genannte Funktion „Visual Look Up“ auch in Deutschland freischalten. Bislang war die Option nur in den USA verfügbar.

„Visuelles Nachschlagen“ bietet die Möglichkeit, ähnlich wir von Google Lens bekannt, Informationen über bekannte Sehenswürdigkeiten, Kunstwerke, Pflanzen, Haustiere und dergleichen über die Fotos-App abzurufen. Die Funktion wurde mit iOS 15 vorgestellt, lässt sich bislang aber nur auf englischsprachigen Geräten nutzen.

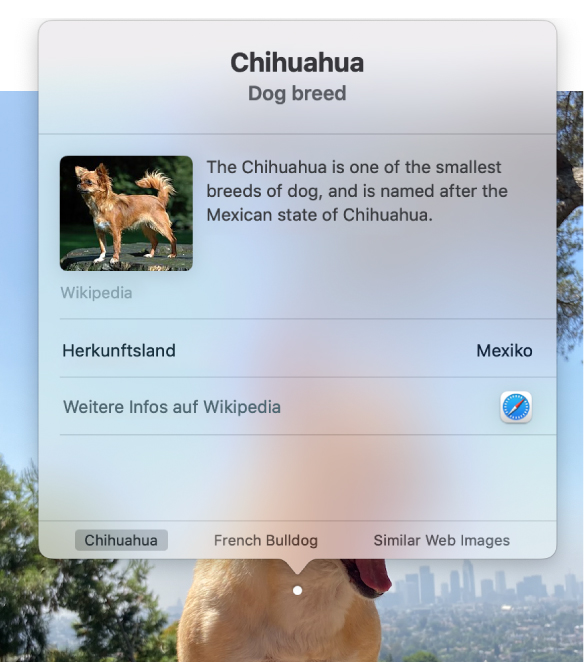

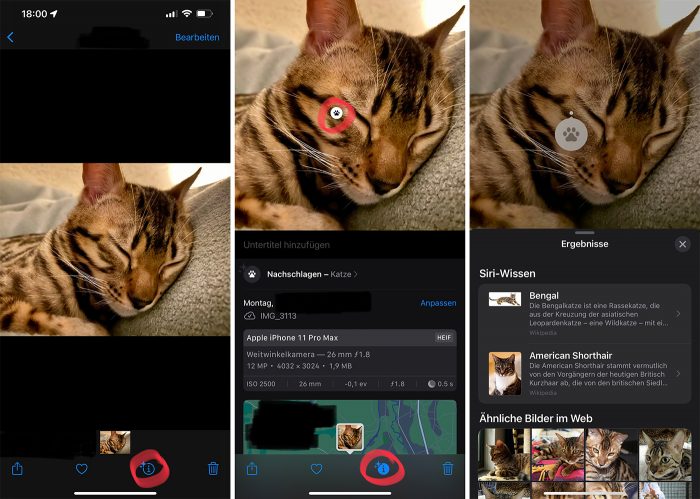

Ob ihr die Funktion im Zusammenhang mit einem eurer Fotos verwenden könnt, hängt davon ab, ob die darauf abgebildeten Objekte erkannt wurden. Wenn dem so ist, zeigen die Sternchen am Info-Knopf in der Fotoansicht Verfügbarkeit von „Visuellem Nachschlagen“ an. Tippt man auf diese Taste, so werden die erkannten Objekte markiert und Tasten mit Symbolen wie Hundepfoten oder Pflanzenblätter erlauben den Abruf von zusätzlichen Informationen.

„Visuelles Nachschlagen“ ist eine Siri-Funktion und setzt im Gegensatz zur reinen Bilderkennung in der Fotos-App eine Internetverbindung voraus. Durch Antippen der Taste startet ihr Quasi eine Siri-Anfrage zu dem erkannten Objekt und bekommt zusätzlich verfügbare Informationen beispielsweise aus Wikipedia geliefert.

„Visuelles Nachschlagen“ setzt in Deutschland iOS 15.4, macOS 15.4 oder macOS 12.3 voraus und erfordert auf dem iPhone mindestens einen A12-Bionic-Prozessor, läuft also ab iPhone-Modellen wie dem XS, XR oder dem SE aus dem Jahr 2020.

„Visual Look Up“ kurz vor Freigabe von iOS 15.4 hinzugefügt

Die Einführung von „Visual Look Up“ beziehungsweise „Visuellem Nachschlagen“ in Deutschland und weiteren Ländern kommt überraschend. Apple hat dies bislang nicht angekündigt und auch im Rahmen der bisherigen Beta-Tests von iOS 15.4 noch nicht angeboten, „Visuelles Nachschlagen“ wurde erst mit dem jetzt für Vorabtester verfügbaren Release Candidate von iOS 15.4 für alle Nutzer freigeschaltet. Wir gehend davon aus, dass die finale Freigabe spätestens Anfang nächster Woche erfolgt.

Das ist mal cool – das hat zwar ganz schön gedauert, bis man hier zu Google aufgeschlossen hatte aber besser spät als nie.

+1

Naja schauen wir erst mal ob sie aufgeschlossen haben oder nur ne light Version bereitstellen können :D

Yeah! Lange drauf gewartet! Finde ich super!

Bin gespannt wie gut es ist. Von Google ist es recht praktisch, allerdings nicht so tief im System verankert.

Das klappt erstaunlich gut. Selbst das Schloss bei uns im Ort wurde erkannt.

in Österreich funktioniert es noch nicht

Geht ja auch um Deutschland…

und in meinem Kommentar ging es um Österreich

Auch in der Schweiz nicht

In Uganda mutmaßlich auch nicht..

Doch, da gehts.

@Gabi: worauf bezieht sich dein „da“?

in Uganda wird auch nicht deutsch gesprochen

:D :D

Internetverbindung? Wie darf ich mir das vorstellen? Hash und dann zu apple server wie bei Kinderpornografie Debatte? Das gleiche nur in grün und ohne Strafverfolgungsbehörde dahinter?

Nein. Machine Learning.

Äpfel und Birnen. Nicht gleich Panik verbreiten ;)

Haha. Das machen aber wirklich sehr viele wenn die das mit ihren Verstand nicht begreifen können.

Habe mich das genau gleiche auch gefragt

Unwichtig

so ihr neunmalklugen, dann erklärt mir bitte folgendes:

Machine Learning prahlt apple, dass es auf dem Gerät passiert. Wenn ihr wie so viele hier den Text nicht lest: es wird eine Internetverbindung vorausgesetzt. Warum ist das wohl so? Dies kann ja nur aus folgenden Gründen sein: Entweder die Wikipedia Artikel müssen geladen werden und die Erkennung findet wirklich „On Device“ statt, oder -und das ist meine Frage- die Internetverbindung wird gebraucht, weil Apples Server eher entscheiden können, ob es ein Chihuahua oder nicht ist. Da Apple aber niemals die Fotos einfach so hochladen würde, findet das nun mal mit Hashwerten statt. Womit wir wieder bei der der Kinderporno Debatte wären.

Panik mache ich nicht, die hat aber mal stattgefunden, als Apple die Kinderporno Funktion einführen wollte.

Wahrscheinlich findet die Erkennung wirklich auf dem gerät selbst statt, das hätte man einfach als Antwort schreiben können, wenn man Ahnung von der Materie hat, statt die die Frage nicht ernst zu nehmen und sich auch keine Gedanken darüber zu machen (oder „mit ihrem Verstand“ die Frage nicht begreifen).

Vielleicht sieht @boehser enkel das auch ganz anders und kann mir erklären, was denn so gegensätzliches mit „Äpfel und Birnen“ meint bei einem Thema, in dem alles mehr oder weniger zusammenhängt. Schließlich trennt von den beiden Sachverhalten nicht mehr als eine Internetverbindung und ein paar Zeilen Code, in dem lediglich der Upload Befehl gegeben wird.

Werden auch PKW-Modelle erkannt?

Oder KRAD?

Sehr gute Frage

Menschen, Katzen und Hunde klappten bei einem kurzen Test.

Ein Model Y, Pferde, Ziegen und Schafe nicht.

Versuch macht kluch ;-)

Mit einem Bentley Continental funktioniert es!

Moin!

Also hier wird nichts auf den Bildern erkannt (RC von 15.4 auf iPhone 11).

Selbst die Elbphilharmonie, den Michel, ein Reh, eine Mauis erkennt er nicht.

Aber interessanterweise wird mir auf macOS (RC von 12.3) in dem Fotos Programm bei denselben Fotos angezeigt, was das sein könnte.

Das bedeutet, daß das Feature auch in macOS geht!

Wahrscheinlich läuft die Verarbeitung wie bei der Personenerkennung wenn das iPhone im Ruhezustand ans Netzteil angeschlossen ist.

15.4 immer noch 1 Sekunde Verzug bei Trackübergang…..

Nett! Mehr von so was.

Hurra – meine Fotos werden ausgewertet!

Dein Nickname ist Programm – ehrlich

Aua ;-)

Funktioniert das auch mit der Kamera App? Wär ja cool, wenn man in einer fremden statt einfach kamera draufhalten kann ohne immer erst ein foto machen, in die fotos app gehen, aufs i-icon drücken zu müssen um zu schauen ob was erkannt wurde

Ich glaube das wird mit der Zeit kommen.

Aber aktuell scheint es so noch nicht vorgesehen zu sein.

Ah ok, danke für die Antwort. Ja wäre auf jeden Fall ne sinnvolle Erweiterung :)