Szenenerkennung, Multisearch und Locations

Google Lens: Eindrucksvoller Ausbau der visuellen Suche

Im Rahmen der Entwicklerkonferenz Google I/O 2022 hat der Suchmaschinen-Anbieter Google den Ausbau seiner visuellen Suche Google Lens angekündigt, die sich auf dem iPhone direkt aus der offiziellen Google-App heraus aufrufen und nutzen lässt.

Anhand eines Bildes und dem Zusatz “in meiner Nähe” direkt Händler oder Restaurants um die Ecke finden, die genau das haben, was ihr sucht – das wird zukünftig mit neuen #Multisearch-Funktionen möglich sein. Wie das aussieht ▶️ https://t.co/sKMWkKyNng #GoogleIO pic.twitter.com/eboC6Rvw4i

— Google Deutschland (@GoogleDE) May 12, 2022

Multisearch und Locations

Zum einen integriert Google Lens fortan die sogenannte Multisearch-Funktion, die die gleichzeitige Suche nach Bildern und zusätzlich eingegebenen Suchwörtern ermöglicht. Damit lassen sich dann beispielsweise Fotos von Bäumen mit der zusätzlichen Frage versehen, um was für eine Art von Nadelbaum es sich handelt.

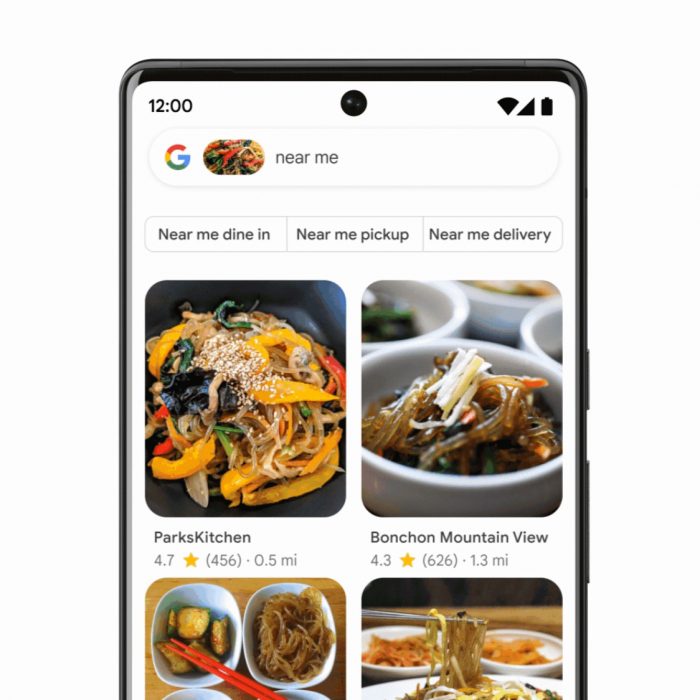

Zum anderen wird Google Lens das Absetzen von Multisearch-Suchen mit zusätzlichen Geoparametern ermöglichen. Anwender sollen dann nach Fotoinhalten suchen, die Suchabfrage aber etwa um den Zusatz „in meiner Nähe“ erweitern können, um so vor allem lokale Ergebnisse zu erhalten. Wann genau die Erweiterung ausgerollt werden soll lässt Google momentan allerdings noch im Unklaren. Die aktuelle Sprachregelung lautet lediglich „im Laufe des Jahres“.

Als Beispiel für den Einsatz von zusätzlichen Geoinformation gibt Google die Suche nach einem bestimmten Gericht an. Wer von diesem etwa nur ein Foto zur Hand hat kann Googles Algorithmen dafür nutzen Restaurants herauszusuchen, die auf der eigenen Menü-Karte Speisen anbieten, die mit der auf dem Foto abgebildeten vergleichbar sind und in unmittelbarer Nähe zum Suchvorgang liegen.

Szenenerkennung im Anmarsch

Zusätzlich hat Google angekündigt Google Lens zukünftig um eine Szenenerkennung ergänzen zu wollen, die nicht mehr nur einzelne Objekte oder Texte analysiert, auswertet und als Sucheingabe nutzt, sondern auch auf große Szenen mit mehreren Objekten reagieren kann.

Als eindrucksvolles Beispiel führt Google ein Schokoladenregal an, auf das die Szenenerkennung automatisch mit dem Einblenden durchschnittlicher Nutzerbewertungen für die unterschiedlichen Schokoriegel reagiert und nach Eingabe zusätzlicher Parameter wie „dunkle Schokolade“ und „ohne Nüsse“ bei der Auswahl empfohlener Produkte hilft.

Ich suche :

– Mehl

– Sonnenblumenöl

– MiniPV Anlage

– Raspberry Pi

– E-Auto

Ich finde:

– Leere Regale

– Lieferdatum in ferner Zukunft

:-)

Und demnächst einen zwielichtigen Verkäufer in der Seitengasse, der all das für eine Niere bei Google anbietet ;)

Google-Lens finde ich richtig klasse und benutze ich sehr häufig.

Einfach mega gut, Google bleibt halt so die Nummer 1 was suchen angeht

Und so billig – man zahlt nur mit seinen Daten!

Wir haben doch alle nichts zu verbergen!

Na dann kann die EU doch kommen.

Lebensmittel-Ampel, bestimmte Inhaltsstoffe, Vergleichspreise – das wären mal interessante Einblendungen!