Der Haustier-Modus

Deep Fusion-Lektüre: Drei Lesetipps für iPhone 11-Nutzer

Apples neue Foto-Funktion, die den diesjährigen iPhone-Modellen vorbehaltene Bildverbesserung „Deep Fusion“ ist vor allem eins: vage.

Zwar lässt mit geschultem Auge erkennen, wenn das iPhone ein gerade geknipstes Bild per „Deep Fusion“-Algorithmus aufbessert – unter welchen Voraussetzungen das neue Feature, das sich nicht ohne weiteres deaktivieren lässt, überhaupt einsetzt ist jedoch unklar.

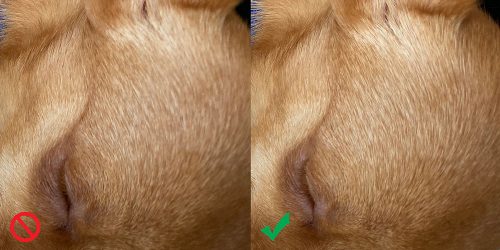

Bild: Gizmodo

Von der Bühnenpräsentation zur iPhone-Vorstellung abgesehen, gibt es von Apple selbst nur die folgenden zwei Sätze zu „Deep Fusion“:

Deep Fusion […] ist ein neues, von der Neural Engine des A13 Bionic ermöglichtes Bildverarbeitungssystem. Deep Fusion nutzt fortschrittliches maschinelles Lernen, um Fotos Pixel für Pixel zu verarbeiten und Textur, Details und Bildrauschen in jedem Teil des Fotos zu optimieren.

Entsprechen möchten wir euch drei Auseinandersetzungen mit dem Thema empfehlen, die die Geheimnisse hinter Deep Fusion zwar nicht wirklich ergründen, aber immerhin feststellen, das sich Haustiere ganz besonders gut zum Anfertigen von Beispiel-Bildern nutzen lassen.

Auch die Macher der Kamera-App Halide haben mit „Inside the iPhone 11 Camera“ eine lesenswerte Abhandlung zum Kamera-Modusl der neuen iPhone-Modelle veröffentlicht, wollen jedoch erst im zweiten Teil ihrer Analyse auf die Deep Fusion-Kapazitäten eingehen.

Bild: birchtree.me

Gizmodo: Deep Look Into Deep Fusion

Dies bringt mich zu einem seltsamen Teil des Deep Fusion-Puzzles. […] Deep Fusion ist ein Rätsel, weil der Workflow verwirrend ist, und in meinen Tests war es manchmal verwirrend zu sagen, wann die Technologie überhaupt funktioniert. […] Wenn Deep Fusion nur gelegentlich und nur sehr spezifisch funktioniert, warum hat Apple auf dem iPhone-Event eine so große Sache daraus gemacht, und warum dauerte es zwei zusätzliche Monate, bis Deep Fusion der Öffentlichkeit zugänglich war?

Zum Artikel: Deep Look Into Deep Fusion.

Petapixel: Deep Fusion Demo

Vielleicht sind die Ergebnisse nicht atemberaubend […] aber Deep Fusion scheint eine spürbare Verbesserung in Textur und Detailwiedergabe zu bieten, die dabei helfen kann, die bereits sehr leistungsfähige Kamera weiter zu verbessern.

Zum Artikel: Deep Fusion Demo.

BirchTree: Deep Fusion is Legit

Der Unterschied ist ziemlich bemerkenswert und selbst das mächtige Pixel 4 kann mit diesem Detailgrad nicht mithalten […] Es ist ein relativ unscheinbares Update, das einem oft nicht auffällt, sieht man es aber, dann ist es ziemlich bemerkenswert.

Zum Artikel: Deep Fusion is Legit.

Eine Kennzeichnung wäre schon wünschenswert, warum kann da nicht ein Label, wie von HDR gekannt, für Deep Fusion gesetzt werden?

+1

Konnte bisher auch keinen Nennenswerte Unterschiede feststellen bei 11 Pro Max.

Bei entsprechenden Lichtverhältnissen & Details ist der Unterschied sehr, sehr groß! Wirklich klasse gemacht.

Habe einige Bilder gemacht Ohne DF und mit. Es zeigt sich bei vielen Bildern ein Signifikanter Unterschied. Das ist schon ein Fetter Schritt. Apple hatte lange gepennt gerade bei Nacht. Aber nun haben sie die Messlatte seh Hoch gelegt.

Woher weißt Du welche mit DF waren? Und nachts kommt ja der Night mode zum tragen…

Lässt sich Relativ einfach Prüfen ;)

Na dann hast du aber eine andere Software als der Rest der Welt, da du Deep Fusion nicht triggern kannst.

Deep Fusion wird nur verwendet wenn man die Funktion deaktiviert hat dass automatisch auch ein Ultraweitwinkelbild geschossen wird.

Also macht man zwei Bilder, einmal mit dieser Funktion aktiv und einmal nicht und das ganze bei nicht optimalen Lichtbedingungen. Um zu prüfen dass Deep Fusion verwendet wurde klickt man dann schnell auf das Bild nachdem man es gemacht hat. Wenn es ca. eine Sekunde braucht bis es scharf wird wurde Deep Fusion benutzt.

Also ein vergleich geht schon….

Du sagst es doch selbst, selbst dann lässt sich nicht vorhersagen ob Deep Fusion wirklich getriggert wird. Es gibt also keine verlässliche Möglichkeit DF wirklich aktiv ein oder auszuschalten. Was imho schade ist.

Da stimme ich dir zu. Aber ist halt Apples Politik. Einfach einfach einfach.

Ich hätte auch gern einen Schalter

Ich habe gehört das Deep Fusion grundsätzlich auch nur funktioniert, wenn man die Option „Fotoausnahme außerhalb der Rahmens“ in den Kamera Einstellungen deaktiviert. Ist das wirklich so? Da würden sich dann 2 tolle Features im Wege stehen.

Das ist tatsächlich so.

Finde ich auch super komisch, dass sich die beiden Funktionen kanibalisieren.

Meine bisherige Erfahrung mit Machine/Deep Learning in Consumer Produkten ist nur negativ.

Die mir gezeigten bzw. meine getesteten Szenarien haben bisher keinen Nutzen von diesen „neuen“ Techniken gezeigt.

Deshalb halte ich das ganze Thema gut so eine Art des Kaisers neue Kleidung. Mehr Bauernfängerei als praktische Anwendung.

Nun ich Fotografiere etwas länger. Der Unterschied ist DEUTLICH.

Wahnsinn :)

Jede Verbesserung ist gut und die Jungs müssen ja nicht alles verstehen.

So etwas gibt es bei der Audioverarbeitung auch. Da geht es um jedes kleine Detail.

Und warum erst zwei Monate später? Weil es so lange Zeit brauchte. Ganz simpel.

pixel peeping!

wenn sich denn an der foto qualität nur mal endlich was entscheidend verändern würde…

Tut sie doch.

Das bekommen sie ja nicht hin. Huawei ist da um einiges besser. Das ist doch bloß künstliches hochrechnen. Was nicht da ist kann auch nicht verbessert werden. Alles Marketing ….

Wo den Bitte ? Huawei macht nix anderes. Alles nur Mathe ;)

Und dazu sind sie auch nicht besser, Apple ist hier mal wieder an der Spitze alle anderen kommen danach

Also es sind schon sichtbare Unterschiede vorhanden. Die Unterschiede sind eben im Detail. Nur seltsam das sie das Ganze so kryptisch gestalten. Die meisten wissen gar nicht ob es nun aktiv ist oder nicht. Ich hoffe da kommt noch eine Kennzeichnung, ähnlich wie bei HDR oder Portrait. Es gibt allerdings eine Möglichkeit es direkt zu sehen. Wenn man direkt nach dem auslösen unten links auf das Foto tippt, bemerkt man für einen kurzen Moment eine Art Glitch. Das Foto wird sozusagen aktualisiert nach der Berechnung durch Deep Fusion. Und die Aufnahme ausserhalb des Rahmes muss leider deaktiviert sein, damit Deep Fusion funktioniert. Auch die Lichtverhältnisse spielen eine Rolle. Ist es eher dunkel, greift Night Shift, bei hellem Licht HDR. Deep Fusion aktiviert sich bei mittlerem bis schwachem Licht.

Kann mir einer sagen, was das kleine Quadrat mit einem Stern in der oberen rechten Ecke bei einigen Fotos in der Fotos-App bedeutet?

Das bedeutet daß die Aufnahme auch ausserhalb des sichtbaren Bildes gemacht wurde. Somit kann man auch nachträglich noch herauszoomen, wenn man so will. Nach 30 Tagen werden diese Zusatzinformationen dann gelöscht.

Super, ich danke dir!

Carsten

Jense

ROP

Deformator

Das ist nur Fake. Ich sehe da keinen Unterschied.

Vielleicht lässt sich mit der Technik nicht automatisch jedes Bild verbessern und es wurde deswegen entschieden sie nicht zu kennzeichnen…